로드 밸런서: 안정적인 대규모 서비스의 핵심 인프라

로드 밸런서는 단순한 트래픽 분산 장치를 넘어 안정적인 온라인 서비스의 필수 요소입니다. L4/L7 로드 밸런서의 차이점, GSLB를 통한 고가용성 확보 전략, 그리고 서비스 성능 최적화를 위한 로드 밸런서의 핵심 원리를 IT 전문 저널리스트의 시각으로 분석합니다.

목차

수천만 서비스의 심장: 로드 밸런서

모바일 웹사이트 방문자의 53%는 페이지 로딩에 3초 넘게 걸리면 이탈합니다. 이러한 사용자 경험은 서비스의 성패를 좌우하는 핵심 요소입니다.

구글, 넷플릭스, 아마존 등 수천만 사용자가 동시에 접속하는 대규모 서비스는 이러한 지연을 최소화하기 위해 막대한 투자를 합니다. 그 중심에는 로드 밸런서가 있습니다.

로드 밸런서는 단순히 트래픽을 분산하는 장치를 넘어, 서비스의 안정성과 성능을 보장하는 필수 인프라입니다. 로드 밸런서 없이는 현대의 안정적인 온라인 서비스는 사실상 불가능합니다.

본 글에서는 로드 밸런서의 핵심 원리, 실제 작동 방식, 그리고 대규모 시스템 구축을 위한 전략을 IT 전문 저널리스트의 시각으로 분석합니다.

로드 밸런서의 진화: 시대별 요구와 기술 발전

1960년대 초기 컴퓨터 네트워크 시대에는 서버가 단일 시스템으로 운영되었습니다. 사용자 수 증가에 따라 단일 서버 과부하 문제가 발생하며 서버 분산의 필요성이 인식되기 시작했습니다.

1980년대 TCP/IP 네트워킹이 확산되면서 다수의 서버를 연결하는 기술이 발전했습니다. 이 시기 초기 형태의 트래픽 분산 기술이 등장했으나, 수동적인 방식으로 자동화에는 한계가 있었습니다.

1990년대 웹 서버의 등장과 함께 웹 트래픽이 폭발적으로 증가했습니다. 하나의 서버로는 감당할 수 없는 트래픽이 발생하자, 자동화된 트래픽 분산 장치의 필요성이 대두되었습니다.

2000년대에는 F5, Citrix와 같은 기업들이 하드웨어 기반 로드 밸런서를 출시했습니다. 이들은 고성능과 안정성을 기반으로 기업 서버에 적용되었으나, 고가의 장비로 인해 소규모 기업의 접근은 어려웠습니다.

2010년대 이후 AWS, Azure 등 클라우드 플랫폼이 로드 밸런서 서비스를 제공하기 시작했습니다. 소프트웨어 기반 로드 밸런서 또한 오픈소스로 등장하며, 다양한 규모의 서비스가 로드 밸런서를 활용할 수 있는 환경이 조성되었습니다.

트래픽 분산의 핵심: L4와 L7 로드 밸런서

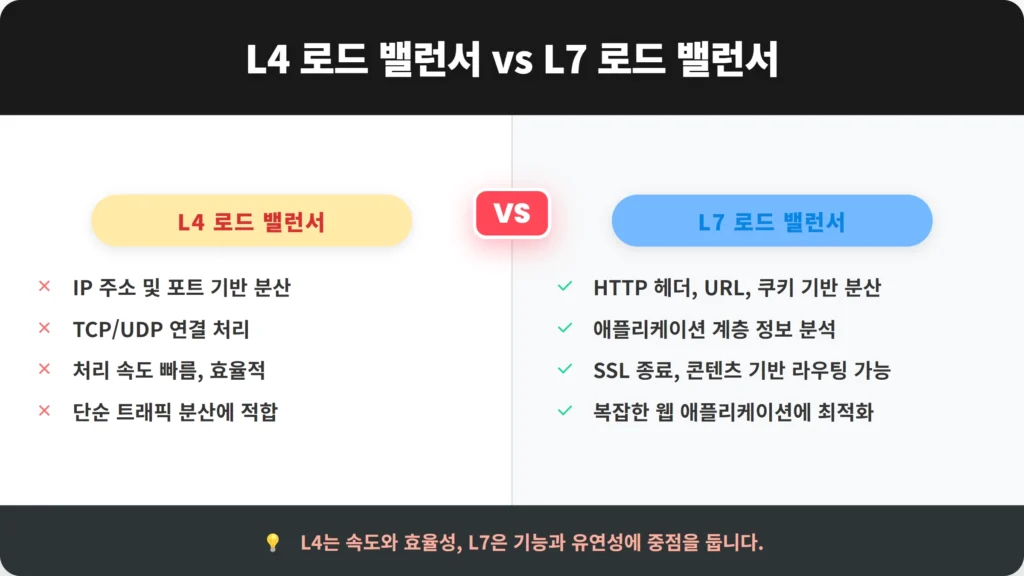

로드 밸런서는 트래픽을 분산하는 방식에 따라 크게 L4와 L7 로드 밸런서로 구분됩니다. 이들은 OSI 7계층 모델의 다른 계층에서 동작하며 각각의 장단점을 가집니다.

L4 로드 밸런서는 네트워크 계층(Layer 4)에서 동작하며, IP 주소와 포트 번호를 기반으로 트래픽을 분산합니다. TCP/UDP 연결만을 고려하기 때문에 처리 속도가 빠르고 효율적입니다. 주로 단순한 트래픽 분산에 적합하며, AWS의 NLB(Network Load Balancer)가 대표적인 예시입니다.

반면, L7 로드 밸런서는 애플리케이션 계층(Layer 7)에서 동작합니다. HTTP 헤더, URL, 쿠키 등 애플리케이션 레벨의 정보를 분석하여 트래픽을 분산합니다. 이러한 심층 분석으로 인해 L4보다 처리 속도는 느리지만, SSL 종료(SSL Offloading) 및 콘텐츠 기반 라우팅과 같은 고급 기능을 제공합니다.

복잡한 웹 애플리케이션에 최적화되어 있으며, AWS의 ALB(Application Load Balancer)가 이에 해당합니다. 로드 밸런서는 헬스 체크 기능을 통해 비정상 서버를 자동으로 트래픽에서 제외하여 서비스 가용성을 높입니다.

페이지 로딩 속도는 사용자 이탈률에 직접적인 영향을 미칩니다. 모바일 웹사이트 방문자의 53%는 페이지 로딩에 3초 넘게 걸리면 이탈합니다. 로드 밸런서는 이러한 지연을 줄여 사용자 경험을 최적화하는 데 핵심적인 역할을 수행합니다.

단일 장애 지점의 역설: GSLB와 고가용성

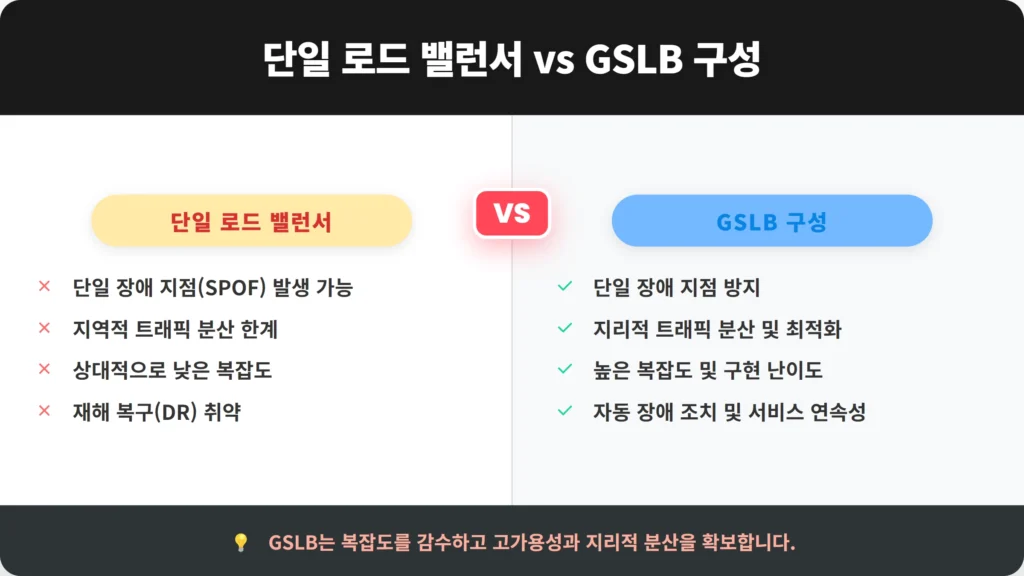

로드 밸런서는 서버 부하를 분산하여 서비스 안정성을 높이지만, 로드 밸런서 자체도 장애가 발생할 수 있습니다. 만약 로드 밸런서가 다운되면 전체 시스템이 마비되는 단일 장애 지점(SPOF)이 될 수 있습니다.

이를 방지하기 위해 GSLB(Global Server Load Balancing)나 고가용성(High Availability) 구성이 필수적입니다. GSLB는 여러 지리적 위치에 분산된 데이터 센터 전반에서 트래픽 부하를 분산하는 기술입니다.

GSLB는 지리적 분산 및 다중화를 통해 단일 데이터 센터 장애 시에도 서비스 연속성을 제공합니다. DNS 기반 라우팅 또는 애니캐스트 방식을 사용하여 사용자와 가장 가까운 서버를 선택하고, 주기적인 헬스 체크를 통해 장애 서버로의 트래픽을 차단합니다.

장애 발생 시 운영자의 수동 개입 없이 자동으로 대체 데이터 센터로 트래픽을 전환하는 자동 장애 조치 기능을 제공합니다. DNS 레코드의 TTL(Time-To-Live) 값을 짧게 설정하여 장애 발생 시 GSLB 상태 정보가 빠르게 동기화되도록 합니다.

이러한 GSLB 구성은 서비스의 고가용성을 극대화하지만, 시스템의 복잡도를 증가시키고 구현 난이도를 높이는 단점도 존재합니다.

안정적인 서비스 구축을 위한 로드 밸런서 전략

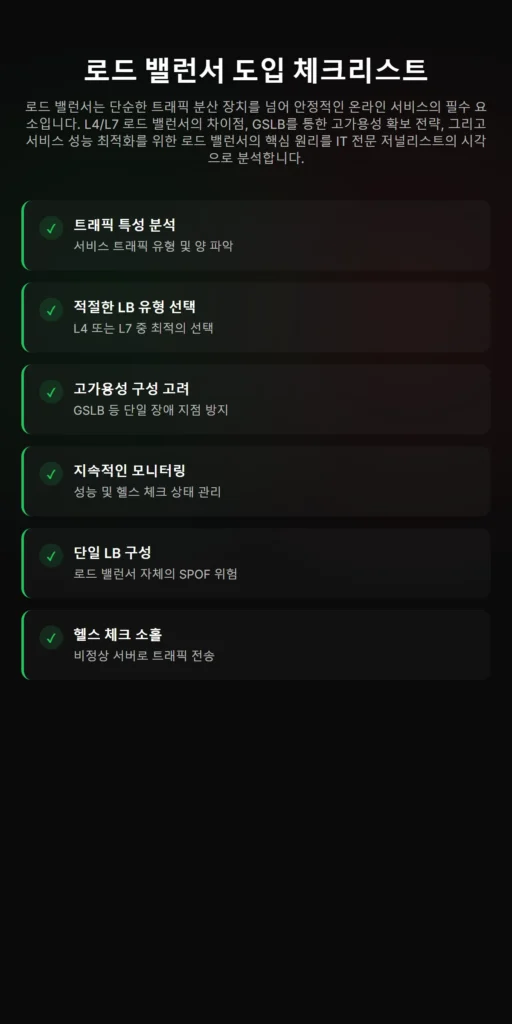

로드 밸런서는 현대 온라인 서비스의 안정성과 성능을 결정하는 핵심 인프라입니다. 단순한 트래픽 분산을 넘어, 사용자 경험을 최적화하고 서비스 연속성을 보장하는 데 필수적인 역할을 합니다.

핵심 포인트:

- 트래픽 특성 이해: 서비스의 트래픽 패턴과 요구사항에 따라 L4 또는 L7 로드 밸런서를 신중하게 선택해야 합니다.

- 고가용성 설계: 로드 밸런서 자체의 단일 장애 지점 가능성을 인지하고, GSLB와 같은 고가용성 구성을 통해 서비스 연속성을 확보해야 합니다.

- 지속적인 모니터링: 로드 밸런서의 성능과 헬스 체크 상태를 지속적으로 모니터링하여 잠재적 문제를 사전에 감지하고 대응해야 합니다.

지금 바로 시작하는 3단계:

- 서비스 트래픽 분석: 현재 서비스의 트래픽 양, 유형(HTTP/HTTPS, TCP/UDP), 세션 유지 필요성 등을 면밀히 분석합니다.

- 로드 밸런서 유형 선택: 분석 결과를 바탕으로 L4 또는 L7 로드 밸런서 중 서비스에 가장 적합한 유형을 결정합니다. 클라우드 환경에서는 AWS ALB/NLB와 같은 관리형 서비스를 고려할 수 있습니다.

- 고가용성 및 확장성 계획: 로드 밸런서 이중화, GSLB 도입 여부, 그리고 미래 트래픽 증가에 대비한 확장 전략을 수립합니다.

흔히 하는 실수:

- 로드 밸런서를 도입했으니 모든 문제가 해결될 것이라고 맹신하는 것.

- 로드 밸런서 자체의 장애 가능성을 간과하고 단일 구성으로 운영하는 것.

- 헬스 체크 설정을 소홀히 하여 비정상 서버로 트래픽이 계속 전송되는 것.

로드 밸런서는 단순한 도구가 아닌, 서비스 아키텍처의 전략적 요소입니다. 올바른 이해와 적용을 통해 안정적이고 확장 가능한 서비스를 구축할 수 있습니다.

이 글의 저작권은 modoomo에 귀속됩니다.